引言:你是否对《黑客帝国》、《终结者》等科幻电影中AI统治人类的场景印象深刻?随着机器学习算法在现实生活中的广泛应用,其负面影响也逐渐显露。不少学者和业界专家指出,如果按照目前机器学习的发展轨迹,科幻电影中压迫性的未来可能成真。

该如何解放人类用户、避免被算法所压迫?本文作者总结了当前机器学习系统的几个压迫性特点,以解放教育学为核理论,提出解放性助手的设计理念,尝试将人与算法带向一个和谐互助的未来。让我们来看看这套设计科学理论有哪些要点吧!

01机器学习的压迫性特点

文章指出,当前的机器学习算法设计对人类具有内在的压迫性,而随着机器学习系统扩展到Informania(信息超载)的规模和范围,这种压迫性可能会进一步加剧。举例来说,在自动驾驶汽车中,机器学习系统可能会将导航数据与购买数据结合起来,选择让乘客路过一个常去的餐厅的路线。再比如,在各类短视频应用中,机器学习系统试图向用户提供它认为用户想看的内容,但这些算法仅使用代表人类偏好的指标(如观看时间)。随着规模的扩大,这些指标可能会失真,因为当前的机器学习系统无法知道或考虑用户可能不想观看另一个视频的情况。最初旨在为用户提供帮助的善意尝试最终可能会变成控制他们注意力的成瘾机制。

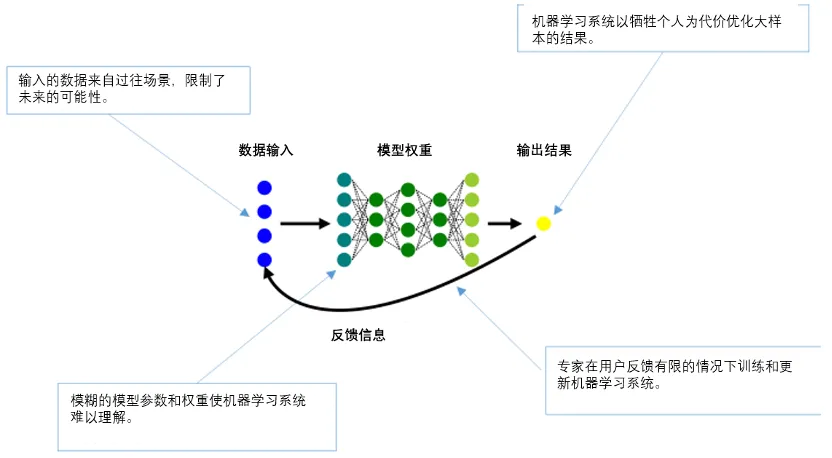

此外,机器学习算法从现有数据中学习的模式也加剧了这种压迫性。文章将机器学习算法的压迫性问题总结为以下四点:

图1 机器学习的压迫性特点

来自MIS Quarterly Vol.45 No.1 / March 2021 Figure 2

第一,机器学习系统以牺牲个体利益为代价来优化结果变量。平台设计者选择的结果变量通常有利于平台而不是个体用户,因此造成对一些用户的压迫。第二,数据输入过于依赖过去,限制了未来的可能性。数据集存在覆盖不全和偏见等问题,反映了过去的情况而限制了未来的可能性。第三,模糊的参数和模型权重使得机器学习系统难以理解。透明性是避免压迫性系统出现的关键,然而,许多机器学习模型的参数和权重被隐藏起来,难以理解其对用户决策的影响。第四,专家训练和更新机器学习系统,而用户反馈有限。在解放性系统的设计中,反复的对话和反馈至关重要,然而,现有的机器学习机制使用户难以向基本的机器学习模型提供有用的反馈。

02 解放性助手和设计原则

综上所述,当前的机器学习模型可能会导致人类面临多种压迫可能性。为了应对这一趋势,文章进一步以解放性教育为核心理论,设计了机器学习系统,以保护人类免受Informania带来的压迫。

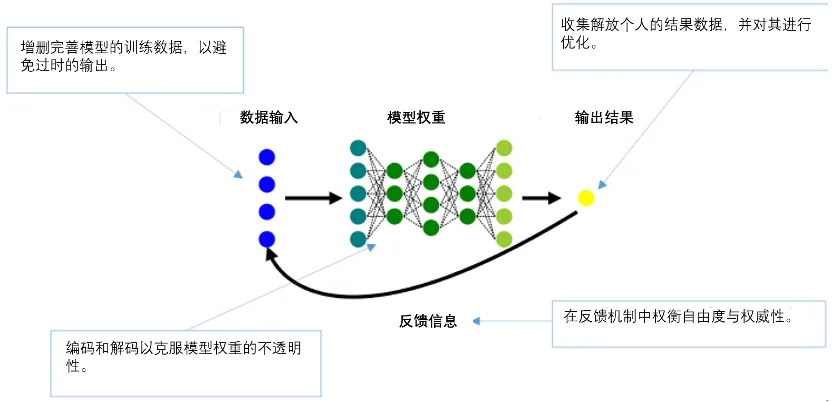

解放性教育主张改变压迫者和被压迫者之间的对话、语言和互动方式,为所有人创造更加解放性的结果。文章提出了一个系统的蓝图,该系统可以实现人与机器学习系统之间新型互动的方式,使组织继续利用机器学习的力量,同时避免了当前轨迹预示的压迫性未来。针对机器学习潜在的压迫性特点,文章提出了解放性助手应具备的特点,如下图所示。

图2 解放性助手具备的特点

来自MIS Quarterly Vol.45 No.1 / March 2021 Figure 3

第一,为了避免大样本结果优化带来的压迫,解放性助手需要收集个体的结果数据,并对其进行优化。第二,由于用户需求会随时间变化,解放性助手需要了解用户的动态经历,增删训练数据,调整模型以适应未来的变化。第三,解放性助手应当实施编码和解码,使机器学习系统与用户之间的通信更加可理解,以克服模型权重的不透明。第四,解放性助手应当修改反馈机制,平衡自由和权威。

那么,我们应该如何设计一个符合解放性助手的特点的系统呢?文章提出了设计解放性机器学习系统的四大原则,如下表所示。在设计机器学习系统时,我们可以参考这些原则。

表1 解放性助手设计原则

来自MIS Quarterly Vol.45 No.1 / March 2021 Table 3

设计原则 |

设计子原则 |

设计丰富的偏好 |

解放性助手应该允许用户展示过去数据中不存在的现有偏好 |

解放性助手应该主动提出新的偏好 |

解放性助手应该告知用户可能的个人权衡 |

设计用于识别和解决冲突 |

解放性助手应该在用户的偏好与信息狂热相冲突时识别冲突 |

解放性助手应该支持解决与信息狂热的冲突 |

解放性助手应该允许用户与他人进行组织行动的沟通 |

设计个性化叙事 |

解放性助手应该根据不同场景定制与信息狂热的机器学习系统分享的用户数据 |

解放性助手应该从用户调整印象的方式中学习 |

解放性助手应该策略性地模糊信息 |

解放性助手应该帮助纠正不准确性 |

设计用于教育关于替代方案 |

解放性助手应该促进多元的视角 |

解放性助手应该学习有助于用户教育的模式 |

解放性助手应该区分数据和对数据的解释 |

03研究启示

解放性助手的广泛应用将彻底改变机器学习领域,促使大型平台公司采取不同的开发方式。通过选择融入解放性助手反馈,设计者能够获取更好的数据集和全方位的反馈机制,以更好地实现他们的目标。例如,在导航系统中,即使没有解放性助手的反馈,机器学习系统也能够制定有效的路线。但人们可能更倾向于使用允许他们优化额外目标的导航系统,比如避开危险桥梁、欣赏美景,或者规划经过自己喜欢的餐厅的路线。这些额外目标是由个人和他们的解放性助手确定的,帮助个人将他们的目标与整体社会利益保持一致,同时尊重个人的目标和愿望。

进一步地,文章启发信息系统研究者为其他新兴技术进行类似的思考和设计科学练习。历史上,技术的能力一直限制着社会的发展。如今,随着技术的迅速发展,以往的限制正在逐渐消失,问题也从“我们能做什么?”转变为“我们应该做什么?” 如果我们将自己局限于调查现有现象或仅对近期影响进行理论化,可能会减弱我们的潜在影响力。鉴于信息系统研究融合了社会和技术专业知识,信息系统研究者应该大胆地推测新兴技术对社会的长期影响。如果这样做,我们的研究可能会对商业和社会产生更为深远的影响,甚至有可能影响这些新兴技术的发展轨迹。

参考文献:Gerald C. Kane, Amber G. Young, Ann Majchrzak, and Sam Ransbotham, 2021. Avoiding an Oppressive Future of Machine Learning: A Design Theory for Emancipatory Assistants. MIS Quarterly, 45(1): 371-396.

文献链接:https://doi.org//10.25300/MISQ/2021/1578

作者信息:

Gerald C. Kane

Position: C. Herman and Mary Virginia Terry Chair of Business Administration and Professor, Department of Management Information Systems, Terry College of Business, University of Georgia.

Area:Social and ethical implications of artificial intelligence and machine learning; Digital transformation; Knowledge management; Information systems and social networks

Site:https://www.terry.uga.edu/directory/gerald-c-kane/

Email:gerald.kane@uga.edu

Amber Young

Position: Assistant Professor of Information Systems, Sam M. Walton College of Business, University of Arkansas

Area:how organizations can design and implement technologies for social good and human empowerment

Site:https://walton.uark.edu/departments/information-systems/directory/uid/agy002/name/Amber+Grace+Young/

Email:ayoung@walton.uark.edu

Ann Majchrzak

Position: Professor Emeritus of Data Sciences and Operations, Marshall School of Business, University of Southern California

Area:Innovation and Organization

Site:https://www.marshall.usc.edu/personnel/ann-majchrzak

Email: MAJCHRZA@USC.EDU

Sam Ransbotham

Position: Professor of Business Analytics, Carroll School of Management, Boston College

Area:IT security; artificial intelligence; and the strategic use of IT.

Site:https://www.bc.edu/bc-web/schools/carroll-school/faculty-research/faculty-directory/sam-ransbotham.html Email:sam.ransbotham@bc.edu